โลกของเว็บไซต์เต็มไปด้วยข้อมูลที่มีคุณค่ามหาศาล แต่การเก็บรวบรวมข้อมูลด้วยมืออาจจะไม่ใช่งานที่มีประสิทธิผลหรือรวดเร็วพอสำหรับการวิเคราะห์ข้อมูลในปริมาณมากๆ ด้วยเหตุนี้เครื่องมือ Data Scraping จึงเป็นทางเลือกที่น่าสนใจที่จะช่วยให้เราสามารถดึงข้อมูลจากเว็บไซต์ต่างๆ มาวิเคราะห์ได้อย่างง่ายดายและอัตโนมัติ ในบทความนี้เราจะมาพูดถึง 5 เครื่องมือ Data Scraping ที่น่าจับตามอง รวมถึงทำความเข้าใจวิธีการทำงานและลำดับความคิดในการเลือกใช้เครื่องมือเหล่านี้ เพื่อให้การวิเคราะห์ข้อมูลของคุณทำได้ง่ายและมีประสิทธิภาพยิ่งขึ้น

ในภาษา Python มี library ที่ชื่อว่า Beautiful Soup ซึ่งเป็นเครื่องมือพื้นฐานสำหรับดึงข้อมูลจากเว็บไซต์ HTML หรือ XML ได้อย่างง่ายดาย ร่วมกับ Requests ที่ใช้สำหรับการส่ง HTTP requests คู่นี้กลายเป็นหัวใจสำคัญในการเริ่มต้นการคราปข้อมูล

import requests

from bs4 import BeautifulSoup

URL = 'http://example.com/data'

response = requests.get(URL)

soup = BeautifulSoup(response.content, 'html.parser')

# ตัวอย่างการดึงข้อมูลที่ต้องการจากเว็บไซต์

for data in soup.find_all('div', class_='data-class'):

print(data.text)

เครื่องมือนี้มีข้อจำกัดในการจัดการกับ JavaScript ซึ่งเป็นส่วนหนึ่งของเว็บไซต์สมัยใหม่ แต่สำหรับเว็บไซต์ที่มีโครงสร้างข้อมูลที่แน่นอน นี่คือตัวเลือกที่ดี

Scrapy คือ Framework ที่ถูกพัฒนาขึ้นสำหรับการดึงข้อมูลจากเว็บไซต์ที่มีโครงสร้างซับซ้อน หรือเมื่อต้องการดึงข้อมูลจำนวนมากๆ Scrapy จะช่วยจัดการเรื่องของการทำงานของ Requests และการจัดเก็บข้อมูลได้อย่างมีระเบียบ

import scrapy

class MySpider(scrapy.Spider):

name = 'example'

allowed_domains = ['example.com']

start_urls = ['http://example.com/data']

def parse(self, response):

# กระบวนการดึงข้อมูลที่ละเอียดยิ่งขึ้น

pass

เมื่อเว็บไซต์ที่คุณต้องการดึงข้อมูลจัดการตัวเองผ่าน JavaScript หรือต้องการ interaction ก่อนจะเห็นข้อมูลที่ต้องการ Selenium ก็เป็นเครื่องมือที่จำเป็น Selenium สามารถจำลองการทำงานของเบราว์เซอร์และสามารถทำ interaction กับเว็บไซต์ได้เหมือนมนุษย์ทำเอง

from selenium import webdriver

driver = webdriver.Chrome('/path/to/chromedriver')

driver.get('http://example.com/data')

# ตัวอย่างการค้นหาข้อมูล

data = driver.find_element_by_class_name('data-class')

print(data.text)

driver.close()

Octoparse เป็นเครื่องมือที่ออกแบบมาสำหรับผู้ใช้ที่ไม่ต้องการเขียนโค้ดใดๆ เพราะมาพร้อมกับ UI ที่ใช้งานง่าย แต่ยังสามารถดึงข้อมูลจากเว็บไซต์ที่ใช้ JavaScript ได้เช่นกัน นอกจากนี้ยังมี feature ในการ schedule การดึงข้อมูลได้ซึ่งเป็นข้อดีสำหรับการเก็บข้อมูลที่ต้องการอัพเดทเป็นประจำ

ParseHub เป็นอีกหนึ่งเครื่องมือที่มีความสามารถในการดึงข้อมูลจากเว็บที่ใช้ AJAX, JavaScript, cookies เป็นต้น เหมือนกับ Octoparse มี UI ที่เข้าใจง่ายและไม่ต้องการให้ผู้ใช้เขียนโค้ด

การใช้งานเครื่องมือ Data Scraping เหล่านี้สามารถช่วยให้นักวิเคราะห์ข้อมูลดึงข้อมูลจากเว็บไซต์ต่างๆ มาใช้ในการวิเคราะห์ได้รวดเร็วและมีประสิทธิภาพมากยิ่งขึ้น อย่างไรก็ตามผู้ใช้ควรพิจารณาถึงข้อจำกัดและนโยบายเกี่ยวกับการเข้าถึงข้อมูลของเว็บไซต์นั้นๆ เพื่อหลีกเลี่ยงปัญหาที่อาจตามมา เครื่องมือเหล่านี้จึงเป็นส่วนหนึ่งของกลยุทธ์ในการวิเคราะห์ข้อมูลและสร้างคุณค่าทางธุรกิจที่สามารถนำข้อมูลที่ได้มาใช้ประโยชน์ในหลายๆ ด้าน

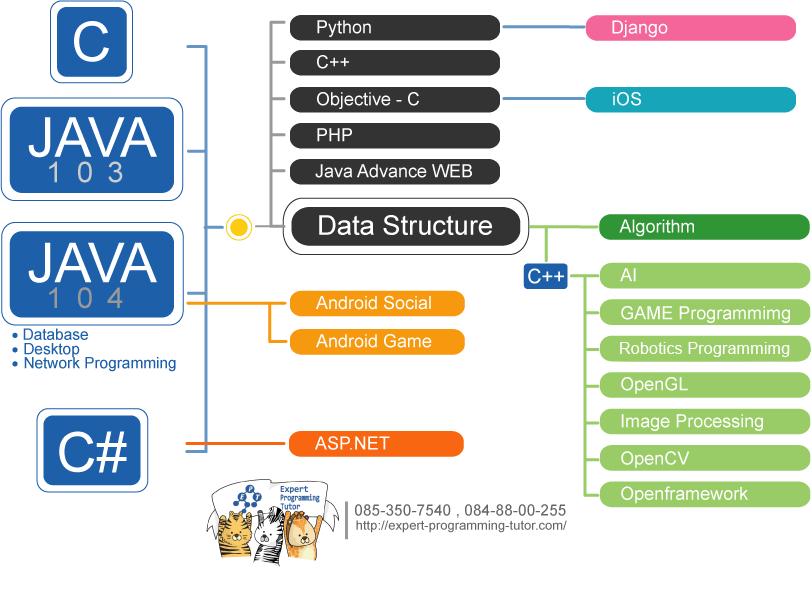

สำหรับผู้ที่สนใจการวิเคราะห์ข้อมูลหรือต้องการสร้างกลยุทธ์ด้านข้อมูลให้แข็งแกร่งมากยิ่งขึ้น การเรียนรู้เพื่อใช้เครื่องมือเหล่านี้อย่างเข้าใจและถูกต้องจะเป็นประโยชน์อย่างมหาศาล หลักสูตรการเขียนโปรแกรมและการวิเคราะห์ข้อมูลที่ EPT จะเป็นตัวช่วยที่ดีในการยกระดับทักษะของคุณให้พร้อมสำหรับการท้าทายในโลกข้อมูลยุคใหม่

หมายเหตุ: ข้อมูลในบทความนี้อาจจะผิด โปรดตรวจสอบความถูกต้องของบทความอีกครั้งหนึ่ง บทความนี้ไม่สามารถนำไปใช้อ้างอิงใด ๆ ได้ ทาง EPT ไม่ขอยืนยันความถูกต้อง และไม่ขอรับผิดชอบต่อความเสียหายใดที่เกิดจากบทความชุดนี้ทั้งทางทรัพย์สิน ร่างกาย หรือจิตใจของผู้อ่านและผู้เกี่ยวข้อง

หากเจอข้อผิดพลาด หรือต้องการพูดคุย ติดต่อได้ที่ https://m.me/expert.Programming.Tutor/

หากมีข้อผิดพลาด/ต้องการพูดคุยเพิ่มเติมเกี่ยวกับบทความนี้ กรุณาแจ้งที่ http://m.me/Expert.Programming.Tutor

085-350-7540 (DTAC)

084-88-00-255 (AIS)

026-111-618

หรือทาง EMAIL: NTPRINTF@GMAIL.COM