ในโลกวิชาการด้านการเขียนโปรแกรมและการพัฒนาโมเดลการเรียนรู้ของเครื่อง (Machine Learning), อัลกอริทึมที่ชื่อว่า "Gradient Descent" นับเป็นหนึ่งในองค์ประกอบสำคัญที่ใช้ในการหาค่าต่ำสุด (minimal point) ของฟังก์ชันประมาณการใด ๆ หรือในทางปฏิบัติ คือการหาค่าพารามิเตอร์ที่ทำให้ค่าความสูญเสีย (loss) ของโมเดลนั้นมีค่าน้อยที่สุดเท่าที่จะทำได้ หรือที่เรียกว่า "optimization".

Gradient Descent เป็นอัลกอริทึมที่ใช้ในการหาค่าต่ำสุดของฟังก์ชันใด ๆ โดยการเคลื่อนที่ลงไปตามความชัน (gradient) ที่ชี้ไปทางค่าที่น้อยลง จนกว่าจะไปถึงจุดที่ความชันนั้นเป็นศูนย์หรือเป็นระดับที่ต่ำสุดที่สามารถหาได้ ชื่อ "Gradient Descent" จึงมาจาก "gradient" หมายถึงความชันหรืออนุพันธ์ และ "descent" หมายถึงกระบวนการของการเคลื่อนที่ลงสู่จุดที่ต่ำลง

การใช้งาน Gradient Descent เริ่มจากการกำหนดค่าพารามิเตอร์เริ่มต้น จากนั้นคำนวณความชันของฟังก์ชันความสูญเสียที่จุดนั้น โดยค่าความชันจะบอกทิศทางที่ควร "เดิน" ไป ด้วยการปรับค่าพารามิเตอร์เล็กน้อยในทิศทางตรงกันข้ามกับความชัน และทำซ้ำกระบวนการนี้จนกว่าจะเข้าใกล้บริเวณที่มีความชันเท่ากับศูนย์ หรือจนกว่าการปรับปรุงจะเล็กน้อยจนไม่มีผลอะไรแล้ว นั่นคือจุดที่ความสูญเสียมีค่าต่ำสุดหรือ local minimal ของฟังก์ชัน

ในโลกของ Machine Learning และ Deep Learning, เรามักจีบพบกับฟังก์ชันความสูญเสียที่มีพารามิเตอร์มากมาย ที่ต้องการ "ปรับตั้ง" (tune) ให้ได้ค่าที่ดีที่สุด ในการหาค่าเหล่านี้เราต้องใช้อัลกอริทึมการหาค่าโหมดหัวระดับสูง เช่น Gradient Descent ซึ่งทำให้การค้นหาค่าที่เหมาะสมเป็นไปอย่างมีประสิทธิภาพและเป็นระบบ

import numpy as np

# สมมติฐานเรามีฟังก์ชัน f(x) = x^2

def f(x):

return x ** 2

# คำนวณ gradient ของฟังก์ชัน f(x)

def f_gradient(x):

return 2 * x

# Gradient Descent

def gradient_descent(start_x, learning_rate, n_iterations):

x = start_x

for _ in range(n_iterations):

grad = f_gradient(x)

x = x - learning_rate * grad # อัปเดตค่า x

print(f"iteration: {_}, x value: {x}")

return x

# หาค่าต่ำสุดของฟังก์ชัน f(x) เริ่มที่ x=10, learning rate=0.2, จำนวน iterations=10

minimum_x = gradient_descent(10, 0.2, 10)

print(f"The minimal point is at x = {minimum_x}, with f(x) = {f(minimum_x)}")

ในโค้ดข้างต้น เราต้องการหาค่าต่ำสุดของฟังก์ชัน $f(x) = x^2$ โดยการใช้ Gradient Descent เราเริ่มต้นที่จุด x=10 และใช้อัตราการเรียนรู้ (learning rate) 0.2 จำนวนการทำซ้ำ (iterations) 10 ครั้ง โดยหลังจากทำซ้ำ 10 ครั้งเราได้จุดที่คิดว่าเป็นต่ำสุด หรือ minimal point

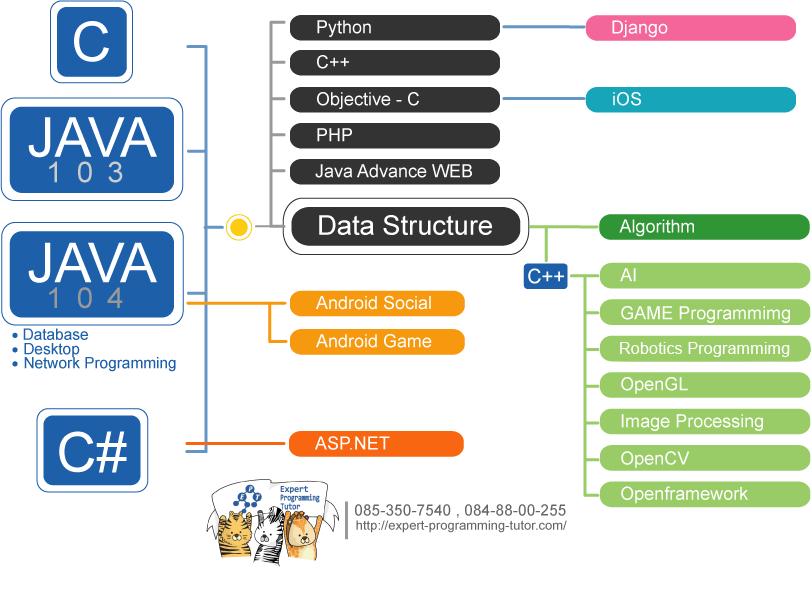

การเข้าใจ Gradient Descent ไม่เพียงแต่ช่วยในการพัฒนาโมเดล Machine Learning เท่านั้น แต่ยังเป็นหัวใจสำคัญของหลายๆ ปัญหาที่เกี่ยวข้องกับการหาค่าที่เหมาะสมทางวิศวกรรม หากคุณสนใจที่จะเจาะลึกลงไปในโลกของการเขียนโปรแกรมและอัลกอริทึมที่ใช้ในการแก้ปัญหาทางคณิตศาสตร์และวิศวกรรม ที่ EPT (Expert-Programming-Tutor) เรามีหลักสูตรที่จะช่วยให้คุณเข้าใจหลักการเหล่านี้อย่างลึกซึ้ง พร้อมจากการเรียนรู้แบบปฏิบัติ เข้าร่วมกับเราวันนี้และก้าวขึ้นไปอีกขั้นในการเป็นนักพัฒนาซอฟต์แวร์และนักวิทยาการคอมพิวเตอร์!

หมายเหตุ: ข้อมูลในบทความนี้อาจจะผิด โปรดตรวจสอบความถูกต้องของบทความอีกครั้งหนึ่ง บทความนี้ไม่สามารถนำไปใช้อ้างอิงใด ๆ ได้ ทาง EPT ไม่ขอยืนยันความถูกต้อง และไม่ขอรับผิดชอบต่อความเสียหายใดที่เกิดจากบทความชุดนี้ทั้งทางทรัพย์สิน ร่างกาย หรือจิตใจของผู้อ่านและผู้เกี่ยวข้อง

หากเจอข้อผิดพลาด หรือต้องการพูดคุย ติดต่อได้ที่ https://m.me/expert.Programming.Tutor/

หากมีข้อผิดพลาด/ต้องการพูดคุยเพิ่มเติมเกี่ยวกับบทความนี้ กรุณาแจ้งที่ http://m.me/Expert.Programming.Tutor

085-350-7540 (DTAC)

084-88-00-255 (AIS)

026-111-618

หรือทาง EMAIL: NTPRINTF@GMAIL.COM