ในยุคที่ปัญญาประดิษฐ์หรือ AI (Artificial Intelligence) ได้ก้าวเข้ามามีบทบาทที่สำคัญในหลายด้านของสังคม ไม่ว่าจะเป็นธุรกิจ, การศึกษา, ตลอดจนระดับชาติ การกำกับดูแลและจัดการการพัฒนาและการใช้งาน AI ในแบบที่เหมาะสมจึงเป็นเรื่องที่จำเป็นอย่างยิ่ง นี่คือจุดเริ่มต้นของ 'AI Governance' หรือ "การกำกับดูแลปัญญาประดิษฐ์" ครับผม

AI Governance เป็นกรอบการทำงานหรือหลักเกณฑ์ที่ถูกกำหนดขึ้นเพื่อบริหารจัดการเกี่ยวกับการพัฒนา, การใช้งาน, และการตรวจสอบปัญญาประดิษฐ์ให้มีความรับผิดชอบ โปร่งใส และเป็นธรรม ซึ่งรวมถึงเรื่องของความปลอดภัย, ความเป็นส่วนตัวของข้อมูล, และเรื่องของจริยธรรม

พลังของ AI นั้นมหาศาล ในทางที่ดีมันสามารถช่วยเราแก้ไขปัญหาอันซับซ้อน ปรับปรุงภาวะการทำงาน และสร้างนวัตกรรมใหม่ๆ แต่ในทางที่เสียหาย AI ที่ไม่ถูกควบคุมอาจนำไปสู่การละเมิดสิทธิ์, ความเหลื่อมล้ำ, หรือแม้กระทั่งความไม่ปลอดภัยที่เกิดจากความผิดพลาดหรือการถูกใช้ในทางที่ผิด

1. แนวทางจริยธรรม

การพัฒนา AI ต้องยึดหลักความถูกต้องทางจริยธรรม เช่น ความซื่อสัตย์, ความยุติธรรม, และความโปร่งใสในการทำงาน

2. กฎหมายและข้อบังคับ

ต้องมีการปฏิบัติตามกฎหมายที่เกี่ยวข้อง อาทิเช่น กฎหมายเกี่ยวกับข้อมูลส่วนบุคคล GDPR ในสหภาพยุโรป

3. การวางกรอบความรับผิดชอบ

มีความชัดเจนในเรื่องของผู้ที่รับผิดชอบในกรณีที่ AI ได้เกิดข้อผิดพลาดหรือนำผลกระทบที่ไม่พึงประสงค์ต่อบุคคลหรือสังคม

4. การตรวจสอบและการควบคุม

ต้องมีการติดตามและประเมินผลการทำงานของ AI เพื่อให้แน่ใจว่ามันทำงานตามที่ถูกออกแบบมาและไม่ทำให้เกิดผลเสีย

หนึ่งในการใช้งาน AI ที่ต้องการการกำกับดูแลอย่างเข้มข้น คือระบบตรวจจับการกระทำที่ไม่เหมาะสมในอินเทอร์เน็ต เราต้องมีการกำหนดว่า AI จะต้องระบุความผิดพลาดได้อย่างแม่นยำ พร้อมทั้งไม่ละเมิดสิทธิของผู้ใช้ในการแสดงออก โดยสามารถตัวอย่างของการใช้งาน AI ที่ถูกกำกับดูแลในรูปแบบนี้:

import ai_governance_module

# สมมติว่านี่คือ function ของ AI ที่เอาไว้ตรวจจับการกระทำที่ไม่เหมาะสม

def detect_inappropriate_content(data):

# ทำการประมวลผลข้อมูล

processed_data = ai_governance_module.preprocess(data)

# AI ทำนายว่าข้อมูลนั้นไม่เหมาะสมหรือไม่

prediction = ai_governance_module.predict(processed_data)

return prediction

# และนี่คือการทำงานของ AI Governance ที่ใช้ตรวจสอบและควบคุม AI

if __name__ == "__main__":

data = "ข้อความที่ต้องการตรวจสอบ"

inappropriate = detect_inappropriate_content(data)

if inappropriate:

print("พบข้อความไม่เหมาะสม!")

else:

print("ข้อความปลอดภัย")

# ระบบจะต้องมีการบันทึกล็อกการทำงานและมีคนที่รับผิดชอบในการตรวจสอบอย่างต่อเนื่อง

การกำกับดูแล AI ไม่ใช่เพียงแค่ควบคุมเทคโนโลยีเอาไว้ให้อยู่ในกรอบเท่านั้น แต่ยังรวมถึงการสร้างความเชื่อมั่นให้กับสังคม ว่า AI นั้นจะถูกนำไปใช้ในทางที่ถูกต้องและเป็นประโยชน์สูงสุด

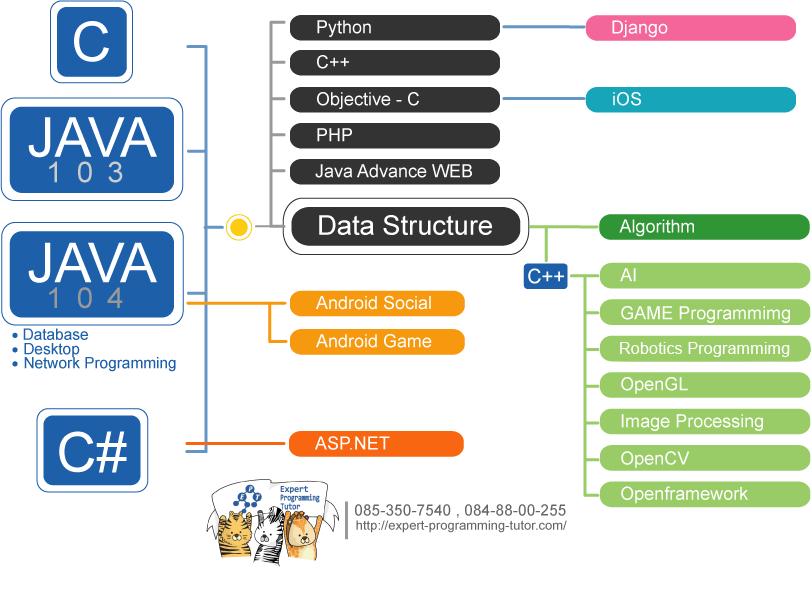

โรงเรียนสอนการเขียนโปรแกรมเช่น EPT (Expert-Programming-Tutor) พร้อมที่จะฝึกคุณให้มีทักษะในการพัฒนา AI ที่มีความรับผิดชอบ และอาจให้ความรู้เกี่ยวกับ AI Governance โดยไม่ต้องตามหาที่อื่นอีกแล้ว การเรียนรู้กับเราจะช่วยปูทางให้คุณทำความเข้าใจกับตลาดงานในอนาคตอย่างล้ำหน้าและรับมือกับความท้าทายในยุค AI ได้อย่างมั่นใจครับผม!

หมายเหตุ: ข้อมูลในบทความนี้อาจจะผิด โปรดตรวจสอบความถูกต้องของบทความอีกครั้งหนึ่ง บทความนี้ไม่สามารถนำไปใช้อ้างอิงใด ๆ ได้ ทาง EPT ไม่ขอยืนยันความถูกต้อง และไม่ขอรับผิดชอบต่อความเสียหายใดที่เกิดจากบทความชุดนี้ทั้งทางทรัพย์สิน ร่างกาย หรือจิตใจของผู้อ่านและผู้เกี่ยวข้อง

หากเจอข้อผิดพลาด หรือต้องการพูดคุย ติดต่อได้ที่ https://m.me/expert.Programming.Tutor/

Tag ที่น่าสนใจ: ai_governance artificial_intelligence technology_ethics data_privacy regulations responsibility compliance monitoring programming_education ai_development ai_governance_framework data_security ethical_ai ai_monitoring ai_responsibility

หากมีข้อผิดพลาด/ต้องการพูดคุยเพิ่มเติมเกี่ยวกับบทความนี้ กรุณาแจ้งที่ http://m.me/Expert.Programming.Tutor

085-350-7540 (DTAC)

084-88-00-255 (AIS)

026-111-618

หรือทาง EMAIL: NTPRINTF@GMAIL.COM

Copyright (c) 2013 expert-programming-tutor.com. All rights reserved. | 085-350-7540 | 084-88-00-255 | ntprintf@gmail.com