ในยุคของการสื่อสารไร้พรมแดนเช่นปัจจุบัน การแปลภาษาแบบอัตโนมัติด้วยระบบคอมพิวเตอร์ หรือ Machine Translation ได้กลายเป็นหนึ่งในเครื่องมือที่สำคัญสำหรับธุรกิจและการสื่อสารส่วนบุคคล หนึ่งในเทคโนโลยีที่สำคัญในการพัฒนา Machine Translation คือ TensorFlow ซึ่งเป็น Framework สำหรับการพัฒนาปัญญาประดิษฐ์ (AI) ที่ถูกใช้กันอย่างแพร่หลายในด้านการเรียนรู้ของเครื่อง (Machine Learning) รวมถึงการประมวลผลภาษาธรรมชาติ (Natural Language Processing - NLP)

TensorFlow เป็น Open-source Library ที่พัฒนาโดยทีมงานของ Google โดยออกแบบมาเพื่อรองรับการคำนวณที่ซับซ้อน การประมวลผลข้อความใน TensorFlow สามารถทำได้ด้วยการใช้โครงข่ายประสาทเทียม (Neural Networks) โดยเฉพาะแบบ Recurrent Neural Networks (RNN) และในปัจจุบันได้มีการพัฒนาไปใช้วิธี Transformer ซึ่งได้รับความนิยมมากขึ้นในงานแปลภาษา

การแปลภาษาเชิงเครื่องจักรมีบทบาทสำคัญในการทำลายอุปสรรคด้านภาษา โดยใช้อัลกอริธึมที่พยายามทำความเข้าใจและแปลความหมายของข้อความจากภาษาหนึ่งไปยังอีกภาษาหนึ่ง การฝึกโมเดลการแปลภาษาจำเป็นต้องมีข้อมูลคำคู่ หรือชุดคำแปลจากภาษาต้นทางไปยังภาษาปลายทาง อัลกอริธึมเช่น Seq2Seq หรือ Transformer ที่เกิดขึ้นเมื่อเร็วๆ นี้ มักจะถูกใช้ในการพัฒนาโมเดลแปลภาษา

การสร้างโมเดลแปลภาษาใน TensorFlow ต้องการสถานะของการเตรียมข้อมูล ในที่นี้เราสามารถใช้ชุดข้อมูลอย่างเช่น English-to-French จาก WMT (Workshop on Machine Translation) ซึ่งมีตัวอย่างประโยคจำนวนมากในการฝึกโมเดล

ขั้นตอนการสร้างโมเดล

1. เตรียมข้อมูล: ทำการโหลดและทำความสะอาดข้อมูลแปลภาษา 2. สร้างคำศัพท์: สร้าง Tokenizer เพื่อแปลงคำเป็นตัวเลข 3. ออกแบบโมเดล: ใช้ Keras API ใน TensorFlow สำหรับการสร้างโมเดล โดยสามารถใช้ประโยชน์จาก Self-Attention Mechanism ของ Transformer 4. การเทรนและการประเมินผล: เริ่มกระบวนการเรียนรู้โดยใช้ Optimizer เพื่อปรับปรุงประสิทธิภาพของโมเดล และประเมินผลด้วยชุดข้อมูลทดสอบตัวอย่างโค้ดเบื้องต้นสำหรับการสร้างโมเดลด้วย TensorFlow

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras.layers import Input, LSTM, Embedding, Dense

from tensorflow.keras.models import Model

# กำหนดค่าพารามิเตอร์

latent_dim = 256

num_samples = 10000

# กำหนด Input Layer

encoder_inputs = Input(shape=(None,))

x = Embedding(input_dim=num_encoder_tokens, output_dim=latent_dim)(encoder_inputs)

encoder_outputs, state_h, state_c = LSTM(latent_dim, return_state=True)(x)

encoder_states = [state_h, state_c]

decoder_inputs = Input(shape=(None,))

x = Embedding(input_dim=num_decoder_tokens, output_dim=latent_dim)(decoder_inputs)

decoder_lstm = LSTM(latent_dim, return_sequences=True, return_state=True)

decoder_outputs, _, _ = decoder_lstm(x, initial_state=encoder_states)

decoder_dense = Dense(num_decoder_tokens, activation='softmax')

decoder_outputs = decoder_dense(decoder_outputs)

# การสร้างโมเดล

model = Model([encoder_inputs, decoder_inputs], decoder_outputs)

model.compile(optimizer='rmsprop', loss='categorical_crossentropy', metrics=['accuracy'])

# เริ่มการฝึกโมเดล

model.fit([encoder_input_data, decoder_input_data], decoder_target_data,

batch_size=64,

epochs=100,

validation_split=0.2)

ในโค้ดข้างต้นนี้ เป็นการใช้ LSTM ซึ่งเป็นอัลกอริธึมพื้นฐานที่ยังถูกใช้อยู่ในโมเดลการแปลและได้รับแรงบันดาลใจจาก Seq2Seq โมเดลนี้แสดงให้เห็นถึงหลักการทำงานพื้นฐานที่สามารถพัฒนาต่อไปสู่ Transformer ได้

เมื่อพื้นฐานของโมเดลได้รับการสร้างแล้ว ขั้นตอนต่อไปคือทำการปรับปรุงโมเดลผ่านการ Tuning ค่าพารามิเตอร์ต่างๆ เช่น ขนาดของ Embedding, ความลึกของ Network และการใช้ Dropout เพื่อป้องกัน Overfitting โดยสามารถศึกษาจากตัวอย่างที่ปรากฏในแอดวานซ์เทคนิคใน TensorFlow เช่น Data Augmentation, การใช้ Attention Layer หรือแม้กระทั่งการใช้ BERT มาปรับแต่งให้เข้ากับการประมวลผลข้อความ

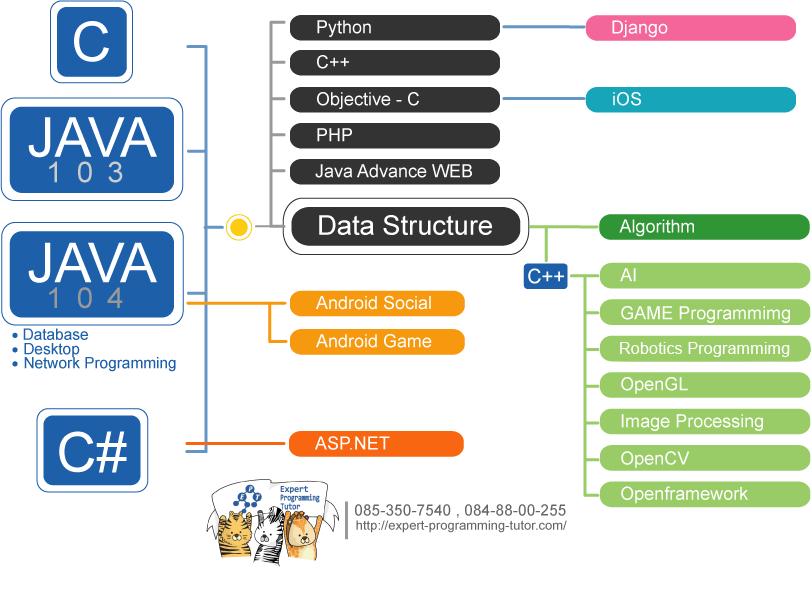

การสร้างและปรับแต่งโมเดล Machine Translation ถือเป็นความท้าทายที่น่าสนใจ และสามารถนำไปสู่โอกาสใหม่ๆ ในการพัฒนาการสื่อสารระหว่างผู้คนที่มีความแตกต่างทางภาษา สถาบันการเรียนด้านการเขียนโปรแกรมอย่าง EPT มอบโอกาสให้คุณศึกษาและเพิ่มพูนความรู้ความสามารถในด้านนี้ ทั้งแง่ทฤษฎีและการปฏิบัติจริงในการสร้าง AI และ Machine Learning ที่สะท้อนถึงศาสตร์แห่งอนาคต

หมายเหตุ: ข้อมูลในบทความนี้อาจจะผิด โปรดตรวจสอบความถูกต้องของบทความอีกครั้งหนึ่ง บทความนี้ไม่สามารถนำไปใช้อ้างอิงใด ๆ ได้ ทาง EPT ไม่ขอยืนยันความถูกต้อง และไม่ขอรับผิดชอบต่อความเสียหายใดที่เกิดจากบทความชุดนี้ทั้งทางทรัพย์สิน ร่างกาย หรือจิตใจของผู้อ่านและผู้เกี่ยวข้อง

หากเจอข้อผิดพลาด หรือต้องการพูดคุย ติดต่อได้ที่ https://m.me/expert.Programming.Tutor/

Tag ที่น่าสนใจ: java c# vb.net python c c++ machine_learning web database oop cloud aws ios android

หากมีข้อผิดพลาด/ต้องการพูดคุยเพิ่มเติมเกี่ยวกับบทความนี้ กรุณาแจ้งที่ http://m.me/Expert.Programming.Tutor

085-350-7540 (DTAC)

084-88-00-255 (AIS)

026-111-618

หรือทาง EMAIL: NTPRINTF@GMAIL.COM