การประมวลผลข้อความเชิงลึกหรือที่เราเรียกกันว่า Natural Language Processing (NLP) คือหนึ่งในศาสตร์ที่มีพลังสูงมากในด้านการพัฒนาโปรแกรมเชิงสื่อสารกับผู้ใช้ เช่น การแปลภาษา การสร้างบทพูด และการสนทนากับผู้ใช้ การประยุกต์ใช้งาน Sequence to Sequence Learning (Seq2Seq) คือหนึ่งในเทคนิคที่ได้รับความนิยมในการประมวลผลข้อความที่ถูกนำมาใช้เพื่อการทำนายลำดับข้อมูลจากอินพุต เพื่อให้มีผลลัพธ์ที่เป็นลำดับใหม่ซึ่งอยู่ในบริบทเดียวกัน

ในบทความนี้ เราจะมาสำรวจว่า TensorFlow สามารถช่วยให้เราเข้าใจและพัฒนาโมเดล Seq2Seq ได้อย่างไร รวมไปถึงกรณีการใช้งานและตัวอย่างโค้ดที่คุณสามารถทดลองได้เอง

Sequence to Sequence เป็นโมเดลการเรียนรู้เชิงลึกที่มีโครงสร้างพื้นฐานมาจากงานวิจัยด้านการแปลภาษา (Machine Translation) และมักจะใช้งานร่วมกับ Recurrent Neural Networks (RNNs) ซึ่งรวมไปถึงโครงสร้าง LSTM และ GRU โมเดลนี้ถูกสร้างขึ้นมาเพื่อให้สามารถแปลงลำดับคำหนึ่งไปเป็นลำดับคำอีกชุดหนึ่งได้อย่างมีประสิทธิภาพ

ขั้นตอนของ Seq2Seq

1. Encoder: รับข้อมูลอินพุตซึ่งอาจเป็นประโยคหรือข้อความ เข้าสู่กระบวนการเข้ารหัสเพื่อนำไปประมวลผล 2. Context Vector: สร้างบริบทจากข้อมูลที่ผ่านการเข้ารหัส 3. Decoder: นำบริบทไปถอดรหัสเพื่อสร้างผลลัพธ์ที่ต้องการ เช่น การแปลประโยค

การใช้งาน Seq2Seq นั้นหลากหลายและมีประโยชน์มากในวงการ NLP ด้านการแปลภาษา โปรแกรมผู้ช่วยส่วนตัว อัตโนมัติการทำสรุปบทความหรือเอกสารอัตโนมัติ และการสร้างแบบสอบถาม

ต่อไปเราจะแสดงตัวอย่างเล็กๆน้อยๆในการเขียนโปรแกรมด้วย TensorFlow เพื่อสร้างโมเดล Seq2Seq

import numpy as np

import tensorflow as tf

from tensorflow.keras.layers import LSTM, Dense, Embedding

from tensorflow.keras.models import Model

# ข้อมูลตัวอย่าง

input_texts = ["สวัสดีครับ", "คุณทำอะไร"]

target_texts = ["hello", "what are you doing"]

# เตรียมข้อมูล (Tokenize)

tokenizer = tf.keras.preprocessing.text.Tokenizer()

tokenizer.fit_on_texts(input_texts + target_texts)

input_sequences = tokenizer.texts_to_sequences(input_texts)

target_sequences = tokenizer.texts_to_sequences(target_texts)

# Parameters

embedding_dim = 64

encoder_units = 128

decoder_units = 128

# สร้างโมเดล Encoder

encoder_inputs = tf.keras.Input(shape=(None,))

encoder_embedding = Embedding(input_dim=len(tokenizer.word_index) + 1, output_dim=embedding_dim)(encoder_inputs)

encoder_outputs, state_h, state_c = LSTM(encoder_units, return_state=True)(encoder_embedding)

encoder_states = [state_h, state_c]

# สร้างโมเดล Decoder

decoder_inputs = tf.keras.Input(shape=(None,))

decoder_embedding = Embedding(input_dim=len(tokenizer.word_index) + 1, output_dim=embedding_dim)(decoder_inputs)

decoder_lstm = LSTM(decoder_units, return_sequences=True, return_state=True)

decoder_outputs, _, _ = decoder_lstm(decoder_embedding, initial_state=encoder_states)

decoder_dense = Dense(len(tokenizer.word_index) + 1, activation='softmax')

decoder_outputs = decoder_dense(decoder_outputs)

# ประกอบโมเดล

model = Model([encoder_inputs, decoder_inputs], decoder_outputs)

# คอมไพล์โมเดล

model.compile(optimizer='rmsprop', loss='categorical_crossentropy')

# สรุปโมเดล

model.summary()

แม้ว่า Seq2Seq จะเป็นโครงสร้างที่ยอดเยี่ยม แต่อย่างไรก็ตามก็มีข้อจำกัดด้านการประมวลผลเช่นกัน การสร้างความสัมพันธ์ในข้อมูลขนาดใหญ่อาจทำให้เกิดปัญหาด้านการปรับโมเดล ทั้งนี้ Attention Mechanism ได้ถูกพัฒนาเพื่อช่วยให้ระบบสามารถให้ความสนใจต่อคำต่างๆ ในบริบทที่หลากหลาย ช่วยเพิ่มประสิทธิภาพในการประมวลผล

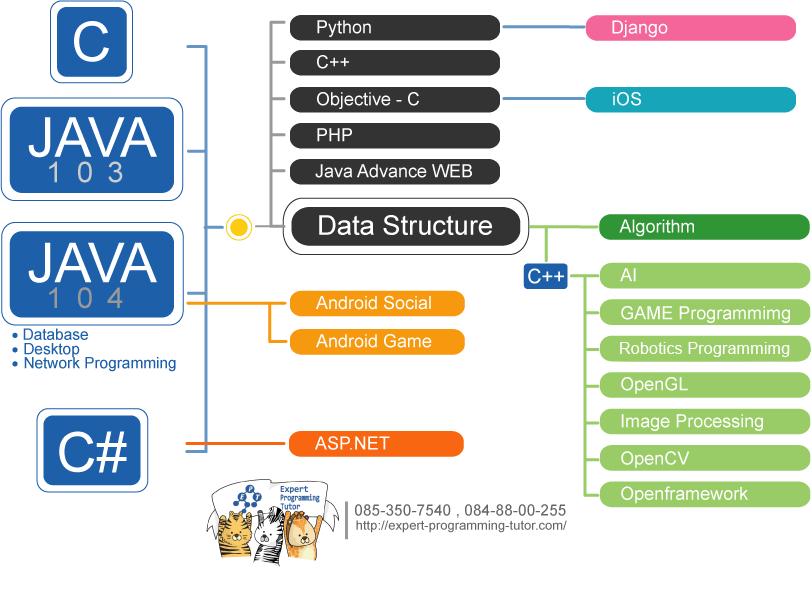

การใช้งาน TensorFlow ในการสร้างโมเดล Sequence to Sequence นั้นช่วยให้เราสามารถพัฒนาแอปพลิเคชั่นที่ซับซ้อนทางด้านการประมวลผลภาษาธรรมชาติได้อย่างมีประสิทธิภาพ การเข้าใจในหลักการและเทคนิคที่ใช้งานจะเป็นรากฐานที่ดีในการพัฒนาทักษะการเขียนโปรแกรมของคุณ ในกรณีที่คุณต้องการเพิ่มพูนความรู้ เราขอแนะนำให้ศึกษาเพิ่มเติมในหลักสูตรต่างๆ ที่ Expert-Programming-Tutor ที่มีการอบรมเชิงลึกและเน้นการปฏิบัติอย่างครบวงจรในด้านนี้และอีกหลายๆ ด้านในโลกของการเขียนโปรแกรม

การศึกษาเชิงลึกเป็นเส้นทางสำคัญที่จะทำให้คุณก้าวขึ้นไปสู่การเป็นนักพัฒนาโปรแกรมที่มีศักยภาพสูงในยุคดิจิทัลอย่างแท้จริง!

หมายเหตุ: ข้อมูลในบทความนี้อาจจะผิด โปรดตรวจสอบความถูกต้องของบทความอีกครั้งหนึ่ง บทความนี้ไม่สามารถนำไปใช้อ้างอิงใด ๆ ได้ ทาง EPT ไม่ขอยืนยันความถูกต้อง และไม่ขอรับผิดชอบต่อความเสียหายใดที่เกิดจากบทความชุดนี้ทั้งทางทรัพย์สิน ร่างกาย หรือจิตใจของผู้อ่านและผู้เกี่ยวข้อง

หากเจอข้อผิดพลาด หรือต้องการพูดคุย ติดต่อได้ที่ https://m.me/expert.Programming.Tutor/

Tag ที่น่าสนใจ: java c# vb.net python c c++ machine_learning web database oop cloud aws ios android

หากมีข้อผิดพลาด/ต้องการพูดคุยเพิ่มเติมเกี่ยวกับบทความนี้ กรุณาแจ้งที่ http://m.me/Expert.Programming.Tutor

085-350-7540 (DTAC)

084-88-00-255 (AIS)

026-111-618

หรือทาง EMAIL: NTPRINTF@GMAIL.COM